گرنت بلشکی (Grant Blashki)، استاد دانشگاه ملبورن و مشاور ارشد سلامت روان، این روزها با پدیدهای جدید در مطبش مواجه شده است: بیمارانی که نه از افسردگی بالینی، که از «اضطراب هوش مصنوعی» شکایت دارند. او تعریف میکند که یکی از بیمارانش با لبخندی نیمهکاره اما نگران، گفته است: فکر میکنم به اضطراب هوش مصنوعی مبتلا شدهام.

احساسی که این بیمار توصیف میکند، برای بسیاری از ما آشناست: ترسی مبهم از تغییرات سریع دنیایی که در آن زندگی میکنیم؛ دنیایی که در آن سامانهها در حال بازطراحیشدن هستند و هیچکس نظر ما را نپرسیده است.

به گزارش هیچ یک _ وبگاه تِکاِکسپلور در گزارشی آورده است:

نظرسنجیهای اخیر نشان میدهد مردم عادی بیش از کارشناسان، نگران پیامدهای هوش مصنوعی هستند؛ بهویژه درباره شغلها و ارتباطات انسانی. اضطراب هوش مصنوعی یک ترس واحد نیست. مجموعهای از نگرانیهای مرتبط است که بسته به سن، سواد فنی، شغل و ارزشهای هر فرد متفاوت است. اما بسیاری از این نگرانیها در چند دسته اصلی جای میگیرند.

از دست دادن شغل و هویت

یکی از بزرگترین نگرانیها تأثیر هوش مصنوعی بر بازار کار است. صندوق بینالمللی پول تخمین میزند نزدیک به ۴۰ درصد مشاغل جهان تحت تأثیر هوش مصنوعی قرار خواهند گرفت. گزارش مجمع جهانی اقتصاد پیشبینی میکند تا سال ۲۰۳۰ میلادی، ۱۷۰ میلیون شغل جدید ایجاد و ۹۲ میلیون شغل حذف شوند.

اما برای بسیاری، کار فقط درآمد نیست. هویت، هدف و ارتباط اجتماعی هم هست. اضطراب نه فقط از ترس بیکاری، که از ابهام درباره جایگاه و ارزش خود در دنیایی که هوش مصنوعی در آن نقش فزایندهای دارد، ناشی میشود.

از دست دادن کنترل

نگرانی دوم را میتوان اثر برادر بزرگ نامید: نقش فزاینده هوش مصنوعی در تصمیمگیریهایی که بر زندگی مردم تأثیر میگذارند؛ از استخدام و اعتبار گرفته تا بیمه و اولویتبندی درمان.

نگرانی فقط این نیست که ممکن است هوش مصنوعی اشتباه کند. این است که تصمیمگیریها غیرشفاف و غیرقابل اعتراض باشند و در عمل درون یک جعبه سیاه رخ دهند. با اینکه اصول هوش مصنوعی سازمان همکاری اقتصادی و توسعه بر شفافیت و پاسخگویی تأکید دارد، اما روندهای جهانی نشان میدهد که در رقابت شرکتها و کشورها برای تسلط بر بازار، این حفاظها اغلب تضعیف میشوند.

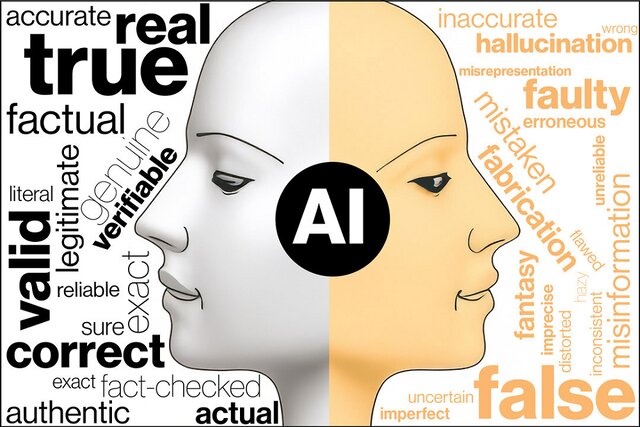

اطلاعات نادرست و دستکاری

هوش مصنوعی هزینه تولید محتوای بسیار واقعی اما کاملاً دروغین را بهشدت کاهش داده است. فناوری دیپفِیک امروز برای کلاهبرداری، جعل هویت و انتشار اطلاعات نادرست استفاده میشود.

گزارشهایی از استرالیا حاکی از تبلیغات دیپفیک به نام یک متخصص سرشناس دیابت برای ترویج مکملهای تأییدنشده است که خطری آشکار برای سلامت عمومی بهشمار میرود. وقتی مردم دیگر نتوانند بهدرستی اطلاعات معتبر را از محتوای مصنوعی تشخیص دهند، اعتماد به نهادها، تخصص و اطلاعات برخط (آنلاین) کاهش مییابد.

حریم خصوصی در معرض تهدید

حریم خصوصی سالهاست که در حال فرسایش است و هوش مصنوعی با توانایی تحلیل حجم عظیمی از دادههای شخصی (رفتاری، زیستی و مکانی) این روند را تشدید کرده است. نظرسنجیها نشان میدهد مردم نگران سوءاستفاده از دادهها، جعل هویت و ازدستدادن حریم خصوصی هستند. این نگرانی فقط به نظارت دولتی محدود نیست، بلکه عملکرد شرکتها در جمعآوری و پروفایلسازی دادهها را هم شامل میشود.

غولهای فناوری و تمرکز قدرت

یکی دیگر از منابع اضطراب، تمرکز قابلیتهای هوش مصنوعی در دست شمار معدودی شرکت و کشور است. بسیاری، نگران آیندهای هستند که در آن تعداد انگشتشماری غول فناوری، قدرت و ثروت نامتناسبی در اختیار داشته باشند. وقتی فناوریهای قدرتمند بهصورت اجتنابناپذیر و بنیادی جلوه میکنند، مردم بهدرستی میپرسند چه کسی سود میبرد، چه کسی خطر را تحمل میکند و پاسخگویی چگونه حفظ میشود.

آموزش در خط مقدم

اضطراب هوش مصنوعی در آموزش بهوضوح دیده میشود. نگرانی فقط تقلب تحصیلی نیست، بلکه این است که آیا آزمونها همچنان درک و یادگیری را میسنجند وقتی خروجی باکیفیت را میتوان به صورت آنی تولید کرد. گزارشهایی از استرالیا و دیگر کشورها نشان میدهد دانشجویان بهطور گسترده از هوش مصنوعی استفاده میکنند. یونسکو هشدار داده هوش مصنوعی مولد سریعتر از آمادگی نهادهای آموزشی پیش میرود و نگرانیهایی درباره حریم خصوصی، برابری و آینده آموزش ایجاد کرده است.

اصالت و معنا

و سرانجام، نگرانی عمیقتری درباره اصالت و معنا وجود دارد. وقتی هوش مصنوعی میتواند نوشتار، تصاویر و گفتوگوهای روان تولید کند، برخی کمتر نگران جایگزینشدن و بیشتر نگران کاهش ارزش کار انسانی هستند. نظرسنجیها نشان میدهد مردم نگراناند هوش مصنوعی تعامل انسانی را کاهش دهد، ارتباطات اجتماعی را تضعیف کند و مهارتهای انسانی را کمارزش سازد. این نگرانیها ضد فناوری نیستند؛ بیانگر تمایل به آیندهای هستند که در آن سهم انسان در کنار ماشینهای قدرتمند همچنان مشاهدهشدنی و معنادار باشد.

برای مقابله با نگرانی از هوش مصنوعی، چه میتوان کرد؟

وقتی مردم نگرانیهای خود را، چه درباره سلامت و چه درباره محیطزیست یا فناوری، با من مطرح میکنند، و این نگرانیها مشخص میشوند، کاهش مییابند. هوش مصنوعی هم تفاوتی ندارد. اگر این ترسها برایتان آشناست، راهکارهای زیر میتوانند کمککننده باشند:

- مشخص کنید که دقیقاً از چه میترسید: هوش مصنوعی بیش از حد کلی است. آیا نگران شغل، اطلاعات نادرست، حریم خصوصی، آموزش یا تصمیمگیری بدون نظارت هستید؟

- منبع اطلاعاتی خود را پالایش کنید: اضطراب هوش مصنوعی اغلب ناشی از تیترهاست نه شواهد. پوشش خبری هیجانی را محدود کنید و به منابع معتبر تکیه کنید.

- سواد هوش مصنوعی خود را افزایش دهید: لازم نیست فنی باشید، اما باید بدانید هوش مصنوعی در حوزه کاری شما چگونه استفاده میشود، کجا کمک میکند، کجا شکست میخورد و چگونه باید خروجیها را بررسی کرد.

- نظارت و پاسخگویی را مطالبه کنید: وقتی از هوش مصنوعی استفاده میشود بپرسید چه کسی پاسخگوست، خطاها چگونه مدیریت میشوند و چه تضمینهایی وجود دارد. از مقرراتی که بر شفافیت، ایمنی و انصاف تأکید دارند حمایت کنید.

سخن پایانی

در این مقطع تاریخی، اضطراب هوش مصنوعی غیرمنطقی نیست. بازتاب تغییرات سریعی است که با کار، آموزش، روابط و هویت ما درآمیخته است. نه انکار مفید است، نه وحشت. آنچه کمک میکند مشارکت، درک و مسئولیت مشترک ماست.